Wie funktioniert KI? - Wann lohnt es, KI einzusetzen?

Kernaussage: Nur mit einem logischen Denkvermögen lässt sich verständlich (und kurz) erklären, wie KI funktioniert und sich lohnt einzusetzen.

Ein logischer Text wählt einen Ausgangspunkt, der tatsächlich oder auch nur im Geiste als Frage formuliert wird. Aus der Antwort auf diese Ausgangsfrage und mit dem Blick auf das Ziel des Textes ergibt sich die nächste Frage, die beantwortet werden muss. So ergeben sich alle Fragen, bis das Ziel des Textes erreicht ist. Dies ist dann das Ende der logische Kette. Ein logischer Text ist gut verständlich: er ist so ausführlich wie nötig und so kurz wie möglich. Ist er zu ausschweifend oder zu kurz, dann ist das schon ein Hinweis darauf, dass er schlecht erklärt.

Damit die Menschen ihre Entscheidungsgewalt über die KI behalten, müssen sie sich weiterentwickeln und ihr logisches, sowie ihr analytisch-kreatives Denkvermögen verbessern.

Wenn Sie schon wissen, wie eine KI funktioniert, sollten Sie gleich zu den beiden Fragen am Ende scrollen:

- Wann lohnt es sich für eine Privatperson KI einzusetzen?

- Wann lohnt es sich für ein Unternehmen KI einzusetzen?

Was ist Intelligenz?

"Intelligenz ... ist die kognitive bzw. geistige Leistungsfähigkeit bei Menschen und zum Teil auch bei Tieren speziell im Problemlösen. (https://de.wikipedia.org/wiki/Intelligenz, 06.06.25)

Abweichend von dieser Definition definiere ich:

Definition: Intelligenz ist die Fähigkeit mit analytisch-kreativem Denken schwierige Problem lösen zu können.

Ein Problem besteht, wenn es ein Ziel gibt, dass nicht erreicht werden kann. Was für den einen Menschen ein Problem darstellt, ist für einen anderen Menschen kein Problem. Je schwieriger und verschiedenartiger die Probleme sind, die ein Mensch lösen kann und je schneller er diese Probleme lösen kann, umso größer ist seine Intelligenz.

Damit Probleme gelöst werden können, müssen die Fakten und Regeln bekannt sein, mit denen eine Methode entwickelt werden kann, die bei ihrer Umsetzung zum Ziel führt. Eine Methode ist der mesit schrittweise Weg zu einem Ziel.

Ohne analytisch-kreatives Denken lassen sich keine Probleme lösen, weil diese Denken und logisches Schließen notwendig sind, um aus Fakten und Regeln eine Methode zu entwickeln (siehe auf Learn-Study-Work "Wie Probleme lösen?").

"... wenn wir in einer unberechenbaren Welt leben würden, in der sich die Dinge zufällig oder auf sehr komplexe Weise änderten, wären wir nicht in der Lage, die Dinge zu verstehen. Wir leben aber in einem ... Universum, in dem sich die Dinge zwar ändern, aber nach Mustern, Regeln oder, wie wir sie nennen, nach Naturgesetzen. ... Und so wird es möglich, Dinge herauszufinden." (Sagan, C. (2013). Cosmos. New York: Randon House Publishing Group, S. 41)

Beispiel:

Wenn ein Mensch krank ist, dann hat er ein Problem. Er geht zu einem Arzt, weil dieser viele Fakten und Regeln zu den verschiedenen Krankheiten kennt. Der Arzt untersucht ("analysiert") den Menschen und schließt aus den Untersuchungsergenissen, um welche Krankheit es sich handelt. Der Arzt kennt auch die Regeln, mit denen die Krankheit geheilt werden kann. So kann er dem Menschen sagen, was dieser tun muss, um sein Problem zu lösen und wieder gesund zu werden.

Was ist Künstliche Intelligenz (KI)?

Definition: Künstliche Intelligenz ist die Fähigkeit technischer Systeme selbstständig schwierige Probleme lösen zu können.

"KI ist die Fähigkeit einer Maschine, menschenähnliche Fähigkeiten wie logisches Denken, Lernen, Planung und Kreativität zu zeigen. KI ermöglicht es technischen Systemen, ihre Umgebung wahrzunehmen, mit dem Wahrgenommenen umzugehen, Probleme zu lösen und zu handeln, um ein bestimmtes Ziel zu erreichen." (www.europarl.europa.eu/topics/en/article/20200827STO85804/what-is-artificial-intelligence-and-how-is-it-used, 13.07.25)

Im Gegensatz zu Menschen kann die Künstliche Intelligenz große Mengen an Daten speichern und schnell auswerten.

Beispiel: medizinisches Expertensystem

Das Wissen einer einzelnen Ärztin ist begrenzt. Ein medizinisches Expertensystem hat das neueste Expertenwissen zu vielen Krankheiten und kann deshalb Ärtze beraten, wenn es aktuelle Untersuchungsergebnisse erhält (wie z. B. Blutwerte): Um welche Krankheit könnte es sich handeln? Wie könnte diese Krankheit behandelt werden?

Beim Auswerten von Daten kann eine KI auf Feinheiten achten und dadurch auch "kleine" Muster/Regeln erkennen.

"KI erkennt Krebs besser als Fachärzte ... Das beste KI-System erreichte eine nahezu einhundertprozentige Erkennungsgenauigkeit und färbte die kritischen Stellen zudem gleich ein. Insgesamt waren sieben der 32 [KI-] Systeme besser als die Pathologen-Gruppe [Facharzt-Gruppe]. Zwar erkannte auch der Experte ohne Zeitlimit die befallenen Proben mit absoluter Präzision, nahm sich für die Untersuchung allerdings auch 30 Stunden Zeit. Die übrigen elf Pathologen [Fachärzte] übersahen vor allem Metastasten mit einer Größe unter 2 mm." (www.hannovermesse.de/de/news/news-fachartikel/ki-erkennt-krebs-besser-als-fachaerzte, 12.07.25)

Beispiel: Schach

Ein Schachkomputer hat Millionen von Schachpartien gegen sich selbst gespielt und beherrscht deshalb Detail-Regeln, die er in bestimmten Situationen anwendet (die Schachwelt staunt dann über einen unerwarteten Zug).

"Der Schachcomputer AlphaZero beispielsweise ... spielt Millionen von Partien gegen sich selbst, um Strategien und Taktiken zu entwickeln, die über das hinausgehen, was ein Mensch sich durch jahrelanges Training aneignen könnte." (ChatGPT)

Was ist die Grundstruktur eines KI-Systems?

Ein KI-System besteht im Prinzip aus diesen Komponenten:

- Dateneingabe (Input): Rohdaten durch Benutzereingaben, aus dem Internet oder aus Datenbanken, von Sensoren oder ...

- Vorverarbeitung: die Rohdaten werde in eine für das System (den Computer, das Modell) nutzbare Form gebracht.

- KI-Modell: Es gibt nicht-lernende und lernende Modelle.

- Das Gerät auf dem das Modell läuft: Smartphones/Computer, Mikrocontroller (z. B. in Haushaltsgeräten), Rechenzentren, KI-Spezialgeräte, Roboter

- Ausgabe (Output): das Ergebnis der KI-Berechnung

- Rückmeldung (Feedback): nicht bei allen KI-Systemen

Ein KI-System erhält Daten, verarbeitet diese und gibt dann in irgendeiner Form ein Ergebnis aus.

Welche Arten von KI gibt es?

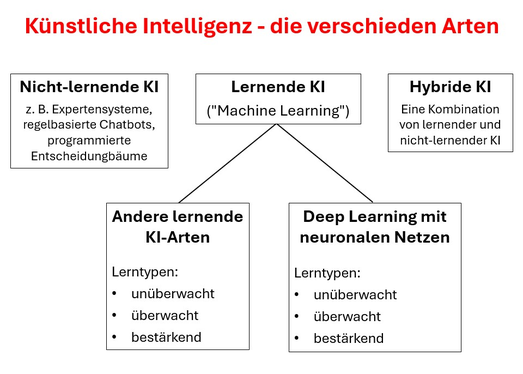

Grundsätzlich kann unterschieden werden zwischen nicht-lernender KI, lernender KI (maschinelles Lernen) und hybrider KI. Hybride KI ist eine Kombination aus lernenden und eine nicht-lernende KI.

"Die Unterscheidung in lernende und nicht-lernende KI ist eine sinnvolle und grundlegende Kategorisierung. Maschinelles Lernen (ML) ist der zentrale Oberbegriff für alle Formen der lernenden KI." (ChatGPT)

Bei der maschinelle Lernen werden die Lerntypen unüberwachtes, überwachtes und bestärkendes Lernen unterschieden (s. u.). Nicht jede lernende KI-Art nutzt alle drei Lerntypen. Deep Learning benutzt auch bestärkendes Lernen (es heißt dann "Deep Reinforcement Learning"). Reinforcement Learning als KI-Art (s. u.) benutzt standardmäßig nur bestärkendes Lernen.

Nicht-lernende KI beruht auf fest programmierten Wissen (Regeln und Fakten) und Logik (s. u.). Sie ist vorhersehbar, weil sie bei gleichen Inputs immer gleich reagiert und sie ist transparent, weil ihre Entscheidungslogik nachvollziehbar ist.

Beispiele für nicht-lernende KI sind Expertensysteme (s. o.), regelbasierte Chatbots (reagieren auf Schlüsselwörter mit vordefinierten Antworten) oder manuell programmierte Entscheidungsbäume.

Die nicht-lernende KI wird auch regelbasierte KI genannt. Das ist zwar richtig, aber lernende KI basiert auch auf Regeln (obwohl diese oft nicht "ausgelesen" werden können), das Besondere an ihr ist aber: sie kann selber Regeln aufstellen. Sie lernt diese Regeln aus dem Training oder durch Erfahrung. Ohne Regeln lassen sich keine Probleme lösen (s. o.).

"Expertensysteme sind eine Art von Künstlicher Intelligenz (KI), die auf einer Sammlung von Regeln, Wissen und Erfahrungen von menschlichen Experten basiert. Expertensysteme lernen nicht selbstständig, sondern ihr Wissen und ihre Entscheidungsprozesse werden manuell programmiert. Die Funktionsweise eines Expertensystems beruht also darauf, dass es vordefinierte Regeln oder logische Abläufe nutzt, um Probleme zu lösen oder Entscheidungen zu treffen.

Im Gegensatz dazu gibt es moderne KI-Systeme wie maschinelles Lernen (Machine Learning), bei denen das System auf Basis von Daten selbstständig Muster [Regeln] erkennt und daraus lernen kann, ohne explizit von Menschen programmiert zu werden. Deep Learning ist ein Teilbereich des maschinellen Lernens, der auf künstlichen neuronalen Netzwerken basiert, die in mehreren Schichten (daher "deep", also tief) organisiert sind. Diese Schichten ermöglichen es dem Modell, komplexe Muster [Regeln] und Zusammenhänge in großen Datenmengen zu erkennen." (ChatGPT)

Mit einfachen Worten ausgedrückt: Experten beherrschen die grundlegenden und auch viele spezielle Regeln auf einem Fachgebiet, aber dadurch, dass eine Deep-Learning-KI (s. u.) mit sehr großen Datenmengen trainiert wurde, hat sie auch kleine Detail-Regeln erkannt, die sie anwendet und so zu besseren Entscheidungen kommt als ein menschlicher Experte.

Beispiel: EKG-Auswertung

Es gibt eine Anwendung, bei der mit Deep-Learning Patienten-EKGs auswertet werden. Dies spart nicht nur Zeit, die Auswertung der EKGs wird auch präziser.

"In dieser Abhandlung wird mit KI das maschinelle (deep) Lernen mit einem neuronalem Netz bezeichnet ... Grundlage für die Erkennung von EKG-Anomalien und die Diagnose von Arrhythmien ist die Unterscheidung normaler und abnormaler einzelner Herzschläge ... Die Unterscheidung dieser Herzschläge im EKG ist schwierig und zeitaufwändig ... KI ist bei der Unterscheidung einer Reihe unterschiedlicher Arrhythmien in Single-Label- und Multi-Label-EKGs genauer als Ärzte in kardiologischen Abteilungen [27]. ... Unüberwachtes Lernen identifiziert sichtbare oder verborgene Datenmuster aus einem unbearbeitetem Datensatz." (Martínez-Sellés, M., & Marina-Breysse, M. (2023). Current and future use of artificial intelligence in electrocardiography. Journal of Cardiovascular Development and Disease, 10(4), 175.)

Bei der lernenden KI wird bezüglich der Art und Weise wie die KI lernt zwischen überwachten, unüberwachten und bestärkendem Lernen unterschieden.

- Beim überwachten Lernen geht es um Vorhersagen: Das Modell soll bekannte Zuordnungen (z. B. Spam oder kein Spam, Ausschuss oder kein Ausschuss) auf neue Daten anwenden.

- Beim unüberwachten Lernen ist das Ziel die Mustererkennung: Ähnliche Daten werden gruppiert, um Strukturen oder Anomalien zu finden (z. B. die EKG-Auswertung).

- Beim bestärkenden Lernen ist das Ziel die Entscheidungsfindung in dynamischen Prozessen: Die KI lernt eine optimale Strategie durch Ausprobieren (z. B. die KI spielt sehr viele Schach-Partien und lernt aus dem Ergebnis "gewonnen oder verloren" die optimale Strategie, um immer zu gewinnen).

Beispiel überwachtes Training:

Die KI soll bestimmen, ob ein Bild eine Katze zeigt oder nicht. Zum Training werden der KI z. B. 1000 Bilder zur Verfügung gestellt. Die Bilder sind gekennzeichnet, ob sie eine Katze zeigen oder nicht. Das KI-Modell lernt die Katzenbilder von anderen Bildern zu unterscheiden, indem es sich schrittweise anpasst: Es vergleicht seine Vorhersagen mit der tatsächlichen Antwort und passt seine internen Gewichte so an, dass die Fehler kleiner werden. Dieser Prozess wird so lange wiederholt, bis das Modell mit hoher Genauigkeit vorhersagen kann, ob ein neues, bisher unbekanntes Bild eine Katze zeigt oder nicht. Bei schwierigen Dingen muss auch ein Mensch längere Zeit üben, bis er sie beherrscht.

Beim unüberwachten Lernen wird der KI beim Training nicht gesagt, welche Daten das gewünschte Ergebnis zeigen und welche nicht. Dann versucht die KI selbstständig die Daten in Klassen einzuteilen.

Das Ziel des unüberwachten Lernens beim Deep Learning ist es, aus unbeschrifteten Daten (also Daten, die keine Zielwerte oder Kennzeichnung haben) nützliche Muster/Regeln zu extrahieren. Es wird eingesetzt, um verborgene Strukturen und Datenbeziehungen zu identifizieren.

Im Gegensatz dazu wird beim überwachten Lernen das Modell mit gelabelten (gekennzeichneten) Daten trainiert, so dass es spezifische Vorhersagen machen kann. (ChatGPT)

Welche Arten von maschinellen Lernen (ML) gibt es?

Teilgebiete des Maschinen Lernens (nach ChatGPT):

- Klassisches ML: Entscheidungsbäume, lineare Modelle, ...

- Deep Learning: Künstliche neuronale Netze (mit vielen Schichten)

- Reinforcement Learning: Lernen durch Belohnung in einer Umgebung

- Selbstüberwachtes Lernen: Modell erzeugt eigene Lernziele

- Transferlernen: Nutzung vortrainierter Modelle in neuen Bereichen

- Meta-Lernen: "Lernen zu lernen" – Modelle lernen Lernstrategien

- Online-Lernen: Fortlaufende Anpassung an neue Daten

Von diesen Teilgebieten ist das Deep Learning das erfolgreichste, weil es extrem komplexe Muster (Regeln) aus großen Datenmengen erlernen kann.

Wie funktioniert Deep-Learning?

Die folgende Antwort von ChatGPT werde ich überarbeiten, damit sie besser verständlich ist (siehe unten):

"Deep Learning funktioniert, indem es künstliche neuronale Netze nutzt, um komplexe Muster aus großen Datenmengen automatisch zu lernen. Es handelt sich dabei um eine spezialisierte Form des maschinellen Lernens, bei der neuronale Netze mit zahlreichen hintereinander geschalteten Schichten (daher „deep“, tief) verwendet werden.

Das Prinzip dieser neuronalen Netze ist an die Funktionsweise des menschlichen Gehirns angelehnt. Ein neuronales Netz besteht aus vielen künstlichen Neuronen, die in verschiedenen Schichten organisiert sind: einer Eingabeschicht, mehreren versteckten Schichten und einer Ausgabeschicht. Jede Schicht enthält eine Vielzahl von Neuronen, die mit Neuronen in der nachfolgenden Schicht verbunden sind. Diese Verbindungen besitzen sogenannte Gewichte, deren Stärke beim Lernen angepasst wird.

Der Lernprozess funktioniert folgendermaßen: Ein Datensatz – beispielsweise Tausende von Bildern mit entsprechenden Labels – wird durch das Netzwerk geschickt. Jedes Bild durchläuft die Eingabeschicht und anschließend mehrere versteckte Schichten. In jeder Schicht werden Merkmale und Muster erkannt: zunächst sehr einfache Merkmale (wie Linien oder Kanten), in den tieferen Schichten komplexere Strukturen (wie Formen oder vollständige Objekte). Schließlich gibt die letzte Schicht eine Vorhersage aus (z. B. „Katze“ oder „kein Katze“).

Anfangs sind diese Vorhersagen noch recht ungenau, da die Gewichte des Netzwerks zufällig gesetzt wurden. Das Netzwerk berechnet deshalb die Differenz zwischen seiner Vorhersage und der tatsächlichen Antwort. Dieser Fehler wird mithilfe eines speziellen Verfahrens – der sogenannten „Backpropagation“ – rückwärts durch das Netzwerk geleitet. Bei diesem Rückwärtsdurchlauf passt das System sämtliche Gewichte zwischen den Neuronen schrittweise so an, dass die Fehler in zukünftigen Durchläufen minimiert werden. Dieser Prozess wird hunderttausend- bis millionenfach wiederholt.

Je mehr Daten das Netzwerk erhält, desto besser kann es generalisieren und Muster erkennen, die ihm helfen, bei neuen, unbekannten Daten korrekte Vorhersagen zu treffen. Durch diese Fähigkeit, eigenständig Merkmale und Zusammenhänge zu erkennen, hat sich Deep Learning besonders in Bereichen wie der Bild- und Spracherkennung sowie der Sprachgenerierung als extrem effektiv erwiesen.

Damit Deep Learning in der Praxis gut funktioniert, benötigt es neben einer ausreichenden Datenmenge auch leistungsstarke Rechenkapazitäten, beispielsweise GPUs (Grafikkarten), da der Trainingsprozess sehr rechenintensiv ist.

Zusammenfassend lässt sich sagen, dass Deep Learning deshalb so erfolgreich ist, weil neuronale Netze eigenständig komplexe Muster lernen und dabei nicht auf vorgegebene Regeln angewiesen sind. Stattdessen passen sie sich flexibel an Daten an und verbessern sich kontinuierlich durch iteratives Lernen." (ChatGPT, https://chatgpt.com/s/t_68fc6c1e22008191a422d842640cf34f, 25.10.25)

Was ist KI und was nicht?

Dialog mit ChatGPT:

Gehört ein Taschenrechner zur KI?

ChatGPT: Nein, ein Taschenrechner arbeitet rein regelbasiert: Er lernt nichts dazu, passt sich nicht an neue Daten an und erkennt keine Muster.

Gehören Expertensysteme zur KI?

ChatGPT: Ja, Expertensysteme gehören zur Künstlichen Intelligenz, allerdings zu einer früheren Generation von KI-Technologien. Sie arbeiten mit explizit formulierten Regeln und Wissen – im Gegensatz zu modernen KI-Methoden wie Machine Learning, die aus Daten lernen. (Natürlich stellt sich die Frage, warum Expertensysteme zu KI gehören, obwohl sie, wie die Taschenrechner, nicht selbstständig lernen.)

ChatGPT hat gelernt, Texte zu verstehen und zu schreiben und wird diesbezüglich immer besser. Ist ChatGPT auch lernfähig bezüglich des Inhalts der Texte oder wird dieser nur aufgrund berechneter Wahrscheinlichkeiten ausgewält?

Den Inhalt eines Textes berechnet ChatGPT aus der Wahrscheinlichkeit der Wörter, die beim Trainig verwendet wurden. Ist das richtig?

ChatGPT: Nicht ganz – das ist eine vereinfachte und etwas missverständliche Darstellung. Ja, ChatGPT nutzt Wahrscheinlichkeiten, um Wort für Wort zu erzeugen. Aber diese Wahrscheinlichkeiten basieren auf einem gelernten Modell komplexer sprachlicher und inhaltlicher Zusammenhänge, nicht auf simplen Wortlisten aus dem Training. Das Modell kann auch auf Fragen antworten, die nicht exakt im Training vorkamen, weil es gelernt hat, wie Sprache funktioniert. Es wurde mit Feedback weiterentwickelt."

Wenn es bei einer Frage zwei mögliche Antworten gibt. Wie unterscheidet ChatGPT, welches die richtige Antwort ist?

ChatGPT: ChatGPT brechnet mit seinem gelernten Sprach- und Wissensmodell für viele mögliche nächste Wörter eine Wahrscheinlichkeit, wie gut sie in den Kontext passen. Das Modell kennt nicht im menschlichen Sinn, was „wahr“ ist. ChatGPT wählt nicht die richtige Antwort, weil es sie "weiß", sondern weil sie im gelernten statistischen Modell am plausibelsten erscheint.

Wenn es zur Zeit von Galileo Galilei schon ChatGPT gegeben hätte, was hätte ChatGPT geantwortet auf die Frage: "Dreht sich die Sonne um die Erde oder dreht sich die Erde um die Sonne?"

ChatGPT: Wenn es zur Zeit von Galileo Galilei (also Anfang des 17. Jahrhunderts) ein Modell wie ChatGPT gegeben hätte, hätte es sich an den vorherrschenden Überzeugungen und den verfügbaren Daten dieser Zeit orientiert – also eher gesagt: "Die Sonne dreht sich um die Erde." Sprachmodelle geben meist die plausibelste Antwort im Kontext der gelernten Daten, nicht unbedingt die objektiv wahre.

Jetzt müsste ich ChatGPT fragen, was unter "plausibelste Antwort" zu verstehen ist. Das spare ich mir aber. Galileo Galilei hatte plausibel begründet, weshalb die Erde sich um die Sonne dreht. Meiner Meinung nach ist die richtige Antwort ist immer die "plausibelste Antwort".

Dieser Chatverlauf bestätigt, dass meine obige Definition richtig ist: "Intelligenz ist die Fähigkeit schwierige Probleme lösen zu können". Schnell eine Formel auszurechnen (was ein Taschenrechner kann), ist ein kleines Problem, herauszufinden, welche seltene Krankheit ein Mensch hat, ist ein schwieriges Problem (siehe das Beispiel für ein Expertensystem oben). Einen lnagen und sprachlich guten Text zu schreiben, ist ein schwieriges Problem (und erfordert Intelligenz), den Inhalt eines Textes aus der Berechnung einer Wahrscheinlichkeit zu bestimmen, ist ein kleines Problem (und erfordert keine oder nur wenig Intelligenz). Der Übergang zwischen nicht-intelligent und intelligent ist fließend.

Wann lohnt es sich für eine Privatperson KI zu nutzen?

Viele Alltagsgeräte enthalten inzwischen eingebaute KI-Funktionen, auch wenn sie äußerlich oft ganz "normal" wirken: Smartphones, Smart-TVs, Smart-Watches, moderne Autos, Haushaltsroboter und smarte Themostate. Echte KI im Alltagsgerät erkennt man daran, dass das System aus Daten lernt und sich anpasst, statt nur feste Befehle auszuführen.

Viele Menschen benutzen auch privat Large-Language-Models (LLMS), wie ChatGPT & Co. Wer keine guten Texte schreiben kann oder ein Anfänger bezüglich eines Themas ist, für den sind diese Modelle sehr nützlich. Durch ChatGPT & Co bekommt man zu einem Thema schnell eine gute Zusammenfassung, die auf der größten Wahrscheinlichkeit ("Plausibelität") beruht. Wenn es um ein Thema geht, bei dem eine Person eine Expertin ist, dann kann sie, wenn sie sprachliche Fähigkeiten hat, wahrscheinlich bessere Texte schreiben als ChatGPT & Co. Trotzdem ist es sinnvoll eigene Texte mit KI-Texten zu vergleichen, weil ein Mensch nie perfekt ist.

Die LLMs entwickeln ihre sprachlichen Fähigkeiten immer weiter. Die sprachliche Qualität eines Textes betrifft die Ausdrucksweise (Stil, Wortwahl, Satzbau), die Struktur (Logik) und Form (Grammatik, Rechtsschreibung). (Siehe auf Learn-Study-Work "Einen guten Text schreiben".) Wenn ich aber auf eine Frage, bei der es mehrere mögliche Antworten gibt, die beste Antwort suche, dann sollte ich weiterhin eine klassiche Literaturrecherche durchführen, um auch neue kreative Antworten zu finden, denn diese haben noch keine hohe Wahrscheinlichkeit und werden von ChatGPT & Co nicht angezeigt.

Wenn ich ChatGPT frage: "Welche Eigenschaften hat ein guter Text?", dann bekomme ich eine sehr gute Antwort, aber ChatGPT kann sein theoretisches Wissen nicht vollständig auf seine eigenen Texte anwenden (siehe auf Learn-Study-Work "Lernen mit ChatGP & Co - die Vor- und Nachteile").

Woran kann man einen von einer KI geschriebenen Text erkennen?

Das Erkennen von KI-generierten Texten wird zunehmend schwieriger, da moderne Sprachmodelle sehr natürliche Texte produzieren. Hinweise auf einen KI-Text sind nach ChatGPT:

- Hohe Sprachglätte, aber fehlende Individualität

- KI-Texte wiederholen oft Kernbegriffe

- KI tendiert dazu, allgemeine Phrasen zu verwenden, wenn keine detaillierte Anweisungen vorliegen. KI kann keine eigenen Erlebnisse schildern.

- Wenn ein Text extrem „regelkonform“ und umfassend auf eine Anweisung eingeht (z. B. jede einzelne Stichpunktanforderung exakt erfüllt), ist das ein KI-Indiz.

Beispiel: Bewerbung auf eine Stellenanzeige als Aushilfe in der Augenoptik

Die rot markierten Textstellen nehmen direkten Bezug auf die Stellenanzeige.

1. Version

Sehr geehrte Damen und Herren,

ich besuche derzeit ein Hamburger Gymnasium und werde im nächsten Jahr mein Abitur machen. Da ich mich für Mode und Accessoires interessiere und den Umgang mit Menschen sehr schätze, bewerbe ich mich als Aushilfe in Ihrem Verkaufsteam.

In den letzten Sommerferien habe ich an fünf Praktikumstagen verschiedene Unternehmen kennengelernt, wobei mir der Tag bei einer Sparkasse besonders gefallen hat – vor allem wegen des direkten Kontakts mit Kunden. Durch meinen großen Freundeskreis bin ich es gewohnt, offen und kommunikativ aufzutreten. Außerdem trage ich selbst regelmäßig eine Brille und weiß, wie wichtig ein gutes Gespür für Stil ist.

Ich bin motiviert, zuverlässig und flexibel einsetzbar und würde mich freuen, Ihr Team tatkräftig zu unterstützen.

2. Version

hiermit bewerbe ich mich bei Ihnen als Aushilfe im Verkauf. Ich bin Schülerin am Gymnasium ... in der 12. Klasse (ich mache 2026 mein Abitur).

In den Sommerferien 2024 habe ich 5 Praktikumstage in Hamburger Unternehmen absolviert. Besonders gefallen hat mir der Tag bei einer Sparkasse, denn ich habe dort gesehen, wie Kunden bedarfsgerecht beraten werden.

Ich selber bin auch modebewusst und öfters trage ich eine Brille mit einfachen Gläsern, weil diese mir besonders gut steht. Außerdem habe ich viele Freundinnen, mit denen ich mich zu allen Themen

austausche.

Es ist klar, dass die 2. Version von einem Menschen geschrieben wurde. Damit dies auch zu sehen ist, wurde er bewußt einfach formuliert. Die Anforderungen der Anzeige in der Bewerbung zu wiederholen, ist nicht kreativ. Die Kreativität liegt darin, Gegebenheiten zu finden, die belegen, dass diese Anforderungen erfüllt werden. Die Informationen über die betreffende Person hat ChatGPT zusammen mit dem Auftrag bekommen, eine passende Bewerbung zu schreiben.

Wenn sich eine Bewerberin die Mühe macht, selber einen Text zu erstellen, sollte das positiv bewertet werden. Ein Text spiegelt auch immer den Charakter der Person wieder, die ihn geschrieben hat. Das Schreiben guter Texte erlernt man nur durch Übung.

Wann lohnt es sich für ein Unternehmen KI zu nutzen?

Die wichtigsten Vorteile von KI gegenüber dem Menschen sind:

- Sie kann sehr große Mengen an Daten speichern ("Big Data").

- Sie kann Daten sehr schnell verarbeiten und mehrere Prozesse gleichzeitig ausführen.

- Sie kann in den Daten "komplexe, nichtlineare" Muster erkennen (Erklärung siehe unten).

- Sie braucht keine Erholungspausen und kann Tag und Nacht durcharbeiten.

- Sie macht keine Fehler und arbeitet emotionslos.

- Sie ist skalierbar, d. h. sie kann mit kleinen Änderungen für verschiedene Fragestellungen eingesetzt werden.

ChatGPT sagt: "KI kann komplexe, nichtlineare Muster erkennen, die Menschen nicht wahrnehmen. ... Ein Muster ist ein Zusammenhang oder eine Regelmäßigkeit in Daten. ... Komplexe, nichtlineare Abhängigkeiten sind verschachtelt, gekrümmt, hängen von vielen Variablen gleichzeitig ab." (In der Schule haben wir auch etwas über nichtlineare Zusammenhänge gelernt.)

Das Problem ist, dass viele Wissenschaftler ihre Erkenntnisse nicht mit einfachen Worten beschreiben wollen. Statt das Wort "Regeln" zu benutzen, verwenden sie das Wort "Muster". (Was sind "Muster" eigentlich genau?)

"... wenn wir in einer unberechenbaren Welt leben würden, in der sich die Dinge zufällig oder auf sehr komplexe Weise änderten, wären wir nicht in der Lage, die Dinge zu verstehen. Wir leben aber in einem ... Universum, in dem sich die Dinge zwar ändern, aber nach Mustern, Regeln oder, wie wir sie nennen, nach Naturgesetzen." (Sagan, C. (2013). Cosmos. New York: Randon House Publishing Group, S. 41)

Da eine KI große Datenmengen sehr schnell verarbeiten kann, findet sie auch die "kleinen, versteckten Regeln", während die Menschen nicht alle Kleinigkeiten/Details berücksichtigen können und nur die "großen (generalisierten) Regeln" erkennen.

"Unser Gehirn ist eigentlich nicht darauf ausgerichtet, Wissen, insbesondere selten gebrauchtes Detailwissen, zu lernen und zu behalten. Jedes menschliche Gehirn ist evolutionär mehr auf ... das Sammeln und Generalisieren von Erfahrungen eingestellt, die das Überleben in seiner Umwelt ermöglichen." (Rost, F. (2018) Lern- und Arbeitstechniken für das Studium. Springer VS, Wiesbaden, S. 34)

Die Nachteile der Menschen sind die Vorteile der KI und umgekehrt.

Der Mensch ist einer KI in Rechenleistung und Datenverarbeitung unterlegen, aber er bleibt überlegen bei Kreativität und kritischen Denken, Ethik, Empathie, Flexibilität und Verantwortung. ... Menschen können neue Ideen entwickeln, die nicht direkt aus vorhandenen Daten abgeleitet sind. (ChatGPT)

1. Kreativität

Der Nachteil der KI ist, dass sie zwar sehr gut auf Bildern Katzen erkennen kann, aber sie weiß nicht, was eine Katze ist (wie sie sich verhält, wie sie sich anfühlt, ...). Eine KI hat nicht so ein Allgemeinwissen wie ein Mensch, weshalb sie nicht gut Analogien finden kann. Ein Mensch kennt durch seine Lebenserfahrung und seine Bildung eine große Menge an Regeln und kann diese auch fachübergreifend anwenden. Das heißt, er findet Analogien (gleiche Eigenschaften oder Verhaltensweisen/Regeln), mit denen er Probleme lösen kann.

"Die Fähigkeit, Ähnlichkeiten und Analogien zu erkennen, ist einer der grundlegendsten Aspekte der menschlichen Kognition. Sie ... spielt eine wichtige Rolle bei wissenschaftlichen Entdeckungen und Kreativität." (Vosniadou, S. & Ortony, A. (1989). Similarity and analogical reasoning, Cambridge: Cambridge University Press, S. 1)

Kreativität erfordert eine starke Vorstellungskraft: einen Möglichkeitssinn und einen Realtiätssinn (siehe auf Learn-Study-Work "Wie kreativ werden"). Durch ihre Erfahrung können Menschen auch mit unvollständigen oder unsicheren Daten vernüftige Entscheidungen treffen.

Da KI bezüglich eines Anwendungsfalls sehr viele Daten und Regeln kennt, kann sie diese kombinieren und Dinge erschaffen, die kreativ wirken. Aber sie hat keine Vorstellungskraft im menschlichen Sinn: Sie hat keine bewusste Fantasie und kann sich nicht "geistig" etwas vorstellen (ChatGPT).

"Der Computer kann interpolieren [bekannte Ideen kombinieren] und damit neue Ideen generieren. Was er nicht (gut) kann, ist extrapolieren, also auf eine grundsätzlich neue Idee kommen, die sich nicht als Überlagerung aller bisher bekannten Ideen ergibt. Ein Computer, der sich doch einmal in den Explorationsraum verirrt, liegt zu 99,9 Prozent falsch." Otte, R. (2023). Künstliche Intelligenz für dummies. John Wiley & Sons , S. 62)

2. Kritisches Denken, Ethik, Empathie, Flexibilität und Verantwortung

- Kritisches Denken: Menschen können Daten hinterfragen, die Quelle prüfen und die Glaubwürdigkeit der Daten einschätzen. Sie können erkennen, ob Daten manipuliert, unvollständig oder irreführend sind.

- Ethik: Menschen können bei der Datenanalyse moralische und gesellschaftliche Konsequenzen berücksichtigen.

- Empathie: Menschen erkennen Stimmungen, Körpersprache, Zwischentöne und können empathisch reagieren.

- Flexibilität: Menschen können sich spontan auf völlig neue Situationen einstellen.

- Verantwortung: Menschen übernehmen Verantwortung für Handlungen und deren Folgen.

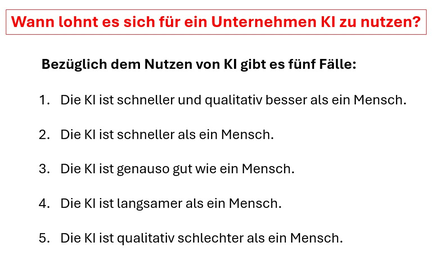

Die Voraussetzung für die Nutzung einer KI ist immer, dass Daten in einer hohen Qualität verfügbar sind und die Investitionskosten nicht zu hoch sind. Wenn ein Mensch viele verschiedene Aufgaben, von denen jede nur relativ selten vorkommt, dann lohnt eine KI wahrscheinlich nicht. Die Übergänge zwischen den Fällen sind fließend.

1. Die KI ist schneller und qualitativ besser als ein Mensch.

Wenn eine große Mengen an komplexen (schwer überschaubaren) Daten verarbeitet werden muss, dann übersteigt das die Leistungsfähigkeit eines Menschen. Eine KI kann solche Daten viel schneller auswerten als ein Mensch und findet bei der Auswertung auch die kleinen "versteckten" Regeln, wodurch das Ergebnis qualitativ besser ist als bei einem Menschen.

Beispiele:

Krebserkennung (s. o.), EKG-Auswertung (s. o.), Schachkomputer (s. o.)

2. Die KI ist schneller als ein Mensch.

Wenn kleine Mengen an überschaubaren Daten ausgewertet werden müssen, dann könnte ein Menschen dies auch erledigen, aber er ist nicht so schnell wie eine KI.

Beispiele:

Automatisierung von Tätigkeiten, Routineaufgaben, bei denen das Ergenis eindeutig ist (Spam oder nicht Spam), ChatGPT schreibt einen Text: Abhängig von seiner Schreibkompetenz schreibt ein Mensch einen besseren oder schlechteren Text, aber ChatGPT schreibt schneller.

3. Die KI ist genauso gut wie ein Mensch.

Ein Mensch arbeitet genauso gut wie eine KI, wenn es um kleine Aufgaben und kleine Datenmengen geht.

Beispiel: Ein Arzt sieht sich das Ergenis der Blutuntersuchung eines Patienten an und erkennt, dass viele Werte im Normalbereich liegen, einer nicht. Zu dem gleichen Ergebnis wäre eine KI auch gekommen.

4. Die KI ist langsamer als ein Mensch.

Ein Mensch ist flexibel und kann sich schnell auf eine neue Situation einstellen, wohingegen eine KI neu "programmiert" werden müsste bzw. sie braucht mehrere Verarbeitungsschritte, bevor sie reagieren kann (z. B. einen herunterfallenden Gegenstand auffangen).

Beispiel:

Wenn ein Prozess noch in der Entwicklung ist und sich ständig verändert, lohnt es sich noch nicht KI einzusetzen.

5. Die KI ist qualitativ schlechter als ein Mensch.

Ein Mensch kann die Verarbeitung von Daten kritisch überprüfen, bezüglich der Glaubwürdigkeit der Daten und der Ethik. Er kann emphatisch und verantwortungsbewußt reagieren.

Beispiel:

Bei einem Luxus-Hotel wird an der Rezeption immer ein Mensch arbeiten.

Fortsetzung folgt ...